andrey-helldar / easy-diffusion-ui-samplers-generator

Easy Diffusion UI的采样生成器

Requires

- php: ^8.1

- ext-imagick: *

- ext-json: *

- archtechx/enums: ^0.3.1

- dragon-code/simple-dto: ^2.7

- dragon-code/support: ^6.8

- guzzlehttp/guzzle: ^7.5

- illuminate/console: ^9.45

- intervention/image: ^2.7

- nesbot/carbon: ^2.64

- symfony/console: ^6.2

- symfony/dom-crawler: ^6.2

Requires (Dev)

- symfony/var-dumper: ^6.2

README

安装

首先,您需要下载并运行Easy Diffusion。

接下来,请确保您的计算机已安装Composer、PHP 8.1或更高版本和Git。

接下来,您可以通过Composer的create-project命令创建一个新的Samplers Generator项目。

composer create-project andrey-helldar/easy-diffusion-ui-samplers-generator easy-diffusion-ui-samplers-generator

或者,您可以下载此存储库。

git clone git@github.com:andrey-helldar/easy-diffusion-ui-samplers-generator.git

接下来,进入项目文件夹并安装依赖项。

cd ./easy-diffusion-ui-samplers-generator

composer install

配置

项目有一些静态设置 - 这些是生成图像的步骤数量和大小。

配置文件位于config文件夹中。

使用方法

首先,您需要运行神经网络Python脚本,更多信息请见https://github.com/cmdr2/stable-diffusion-ui/wiki/How-to-Use

对所有可用模型的采样生成

为此,您需要调用bin/sampler models控制台命令,并传递所需的参数--prompt。

例如

bin/sampler models --prompt "a photograph of an astronaut riding a horse"

如果您想为以前生成的图像生成采样表,则在调用控制台命令时还需要传递带有此值的--seed参数。

例如

bin/sampler models --prompt "a photograph of an astronaut riding a horse" --seed 2699388

可用选项

---prompt- 图像生成的查询字符串。它是一个字符串。--negative-prompt- 查询生成的排除词。它是一个字符串。--tags- 图像生成的修改器。它是一个数组。--fix-faces- 通过GFPGANv1.3启用修复不正确的面孔和眼睛。它是一个布尔值。--path- 保存生成的样本的路径。默认情况下,在当前目录的./build子目录中。--seed- 早期生成的图像的种子ID。--output-format- 设置文件导出格式:jpeg或png。默认为jpeg。--output-quality- 指定输出图像的百分比质量。默认为75。

为单个模型生成采样

为此,您需要调用bin/sampler model控制台命令,并传递所需的参数--prompt和--model。

例如

bin/sampler model --prompt "a photograph of an astronaut riding a horse" --model "sd-v1-4"

如果您想为以前生成的图像生成采样表,则在调用控制台命令时还需要传递带有此值的--seed参数。

例如

bin/sampler models --prompt "a photograph of an astronaut riding a horse" --model "sd-v1-4" --seed 2699388

可用选项

---model- 生成样本的模型。它是一个字符串。---prompt- 图像生成的查询字符串。它是一个字符串。--negative-prompt- 查询生成的排除词。它是一个字符串。--tags- 图像生成的修改器。它是一个数组。--fix-faces- 通过GFPGANv1.3启用修复不正确的面孔和眼睛。它是一个布尔值。--path- 保存生成的样本的路径。默认情况下,在当前目录的./build子目录中。--seed- 早期生成的图像的种子ID。--output-format- 设置文件导出格式:jpeg或png。默认为jpeg。--output-quality- 指定输出图像的百分比质量。默认为75。

根据配置文件为所有模型生成采样

您还可以将Stable Diffusion UI网页界面的配置复制到剪贴板,然后使用任何文件编辑器将这些配置保存到您的计算机上的任何文件夹中。

在文件夹中保存所需数量的配置文件后,您可以通过调用bin/samplers settings --path命令,并传递该文件夹的路径。

bin/samplers settings --path /home/user/samplers # or for Windows bin/samplers settings --path "D:\exports\Samplers"

当运行命令时,脚本将在指定文件夹的根目录中查找所有json文件(不进行递归搜索),检查它们是否填写正确(不正确的文件将被跳过,不会出现错误),并为每个文件开始生成神经网络可用的所有模型的采样器。

采样器表将由配置文件中取出的种子ID生成。

例如,输出信息

INFO: Run: woman.json

INFO aloeVeraSSimpMaker3K_simpMaker3K1

20/20 [============================] 100%

Storing ......................................... 113ms DONE

Elapsed Time ........................... 2 minute 47 seconds

INFO sd-v1-4

20/20 [============================] 100%

Storing ......................................... 113ms DONE

Elapsed Time ............................ 3 minute 7 seconds

INFO: Run: man.json

INFO aloeVeraSSimpMaker3K_simpMaker3K1

20/20 [============================] 100%

Storing ......................................... 113ms DONE

Elapsed Time ........................... 2 minute 12 seconds

INFO sd-v1-4

20/20 [============================] 100%

Storing ......................................... 113ms DONE

Elapsed Time ........................... 3 minute 12 seconds

Output Path .......... /home/user/samplers/2022-12-26_21-06-32

Elapsed Time ........................... 11 minutes 18 seconds

目标文件夹将包含收集的采样器文件(jpeg或png),以及它们的配置集。

例如

/home/user/samplers/woman.json

/home/user/samplers/2022-12-26_21-06-32/woman/aloeVeraSSimpMaker3K_simpMaker3K1__vae-ft-mse-840000-ema-pruned.png

/home/user/samplers/2022-12-26_21-06-32/woman/aloeVeraSSimpMaker3K_simpMaker3K1__vae-ft-mse-840000-ema-pruned.json

/home/user/samplers/2022-12-26_21-06-32/woman/sd-v1-4__vae-ft-mse-840000-ema-pruned.png

/home/user/samplers/2022-12-26_21-06-32/woman/sd-v1-4__vae-ft-mse-840000-ema-pruned.json

/home/user/samplers/man.json

/home/user/samplers/2022-12-26_21-06-32/man/aloeVeraSSimpMaker3K_simpMaker3K1__vae-ft-mse-840000-ema-pruned.png

/home/user/samplers/2022-12-26_21-06-32/man/aloeVeraSSimpMaker3K_simpMaker3K1__vae-ft-mse-840000-ema-pruned.json

/home/user/samplers/2022-12-26_21-06-32/man/sd-v1-4__vae-ft-mse-840000-ema-pruned.png

/home/user/samplers/2022-12-26_21-06-32/man/sd-v1-4__vae-ft-mse-840000-ema-pruned.json

可用选项

--path- 保存生成的样本的路径。默认情况下,在当前目录的./build子目录中。--output-format- 设置文件导出格式:jpeg或png。默认为jpeg。--output-quality- 指定输出图像的百分比质量。默认为75。

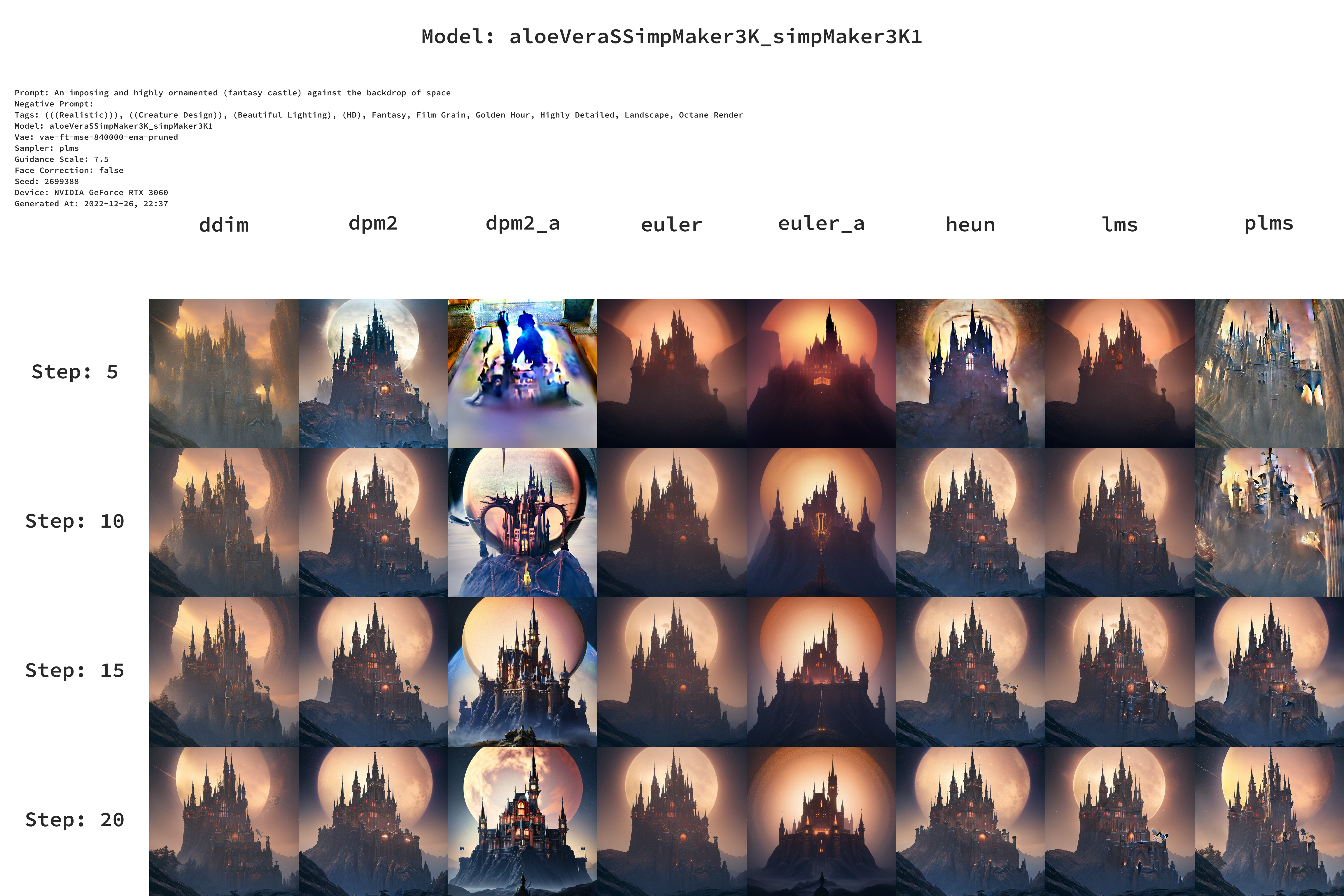

示例

源代码

采样器

配置

最后使用的模型配置已保存到文件中

{

"numOutputsTotal": 1,

"seed": 2699388,

"reqBody": {

"prompt": "An imposing and highly ornamented (fantasy castle) against the backdrop of space, (((Realistic))), ((Creature Design)), (Beautiful Lighting), (HD), Fantasy, Film Grain, Golden Hour, Highly Detailed, Landscape, Octane Render",

"negative_prompt": "",

"active_tags": [

"(((Realistic)))",

"((Creature Design))",

"(Beautiful Lighting)",

"(HD)",

"Fantasy",

"Film Grain",

"Golden Hour",

"Highly Detailed",

"Landscape",

"Octane Render"

],

"width": 512,

"height": 512,

"seed": 2699388,

"num_inference_steps": 20,

"guidance_scale": 7.5,

"use_face_correction": false,

"sampler": "plms",

"use_stable_diffusion_model": "aloeVeraSSimpMaker3K_simpMaker3K1",

"use_vae_model": "vae-ft-mse-840000-ema-pruned",

"use_hypernetwork_model": "",

"hypernetwork_strength": 1,

"num_outputs": 1,

"stream_image_progress": false,

"show_only_filtered_image": true,

"output_format": "png"

}

}

常见问题解答

问:为什么没有用Python编写?

答:我只想在一晚上写一个宠物项目,并且我不懂Python 😁

问:你使用了哪些模型?

答:为了各种目的,我使用以下模型

- 模型

- https://civitai.com/?types=Checkpoint

- https://civitai.com/models/1102/synthwavepunk(版本:3)

- https://civitai.com/models/1259/elldreths-og-4060-mix(版本:1)

- https://civitai.com/models/1116/rpg(版本:1)

- https://civitai.com/models/1186/novel-inkpunk-f222(版本:1)

- https://civitai.com/models/5/elden-ring-style(版本:3)

- https://civitai.com/models/1377/sidon-architectural-model(版本:1)

- https://rentry.org/sdmodels

- https://civitai.com/?types=Checkpoint

- VAE

许可协议

本软件包受MIT许可协议许可。